#21 Re: FSD又出事了

发表于 : 2024年 10月 30日 16:40

Fsd也不能说识别路上的坑。。。还是人开车好,能绕着坑走。。

说白了,还是人类现在制造的电脑算力远远不足以支撑起l3以上自动驾驶的水平。想实现l3还远着呢。macarthur 写了: 2024年 10月 30日 16:35 未必。Camera肯定看到小鹿了,问题出在图像识别上 -- 激光/微波雷达也只是把探测手段从可见光换成激光/微波而已,探测到之后仍然需要进行识别/建模和Visualization。。。

任何方案的图像识别都不可能100%准确。真实世界是开放的,永远有无穷多的惊喜和惊吓,人眼识别也一样可以被轻易欺骗。。。 T家的AI Augmented Visualization已经算是不错的了 -- 只能说人类目前也就这个科技水平,没人能做得更好

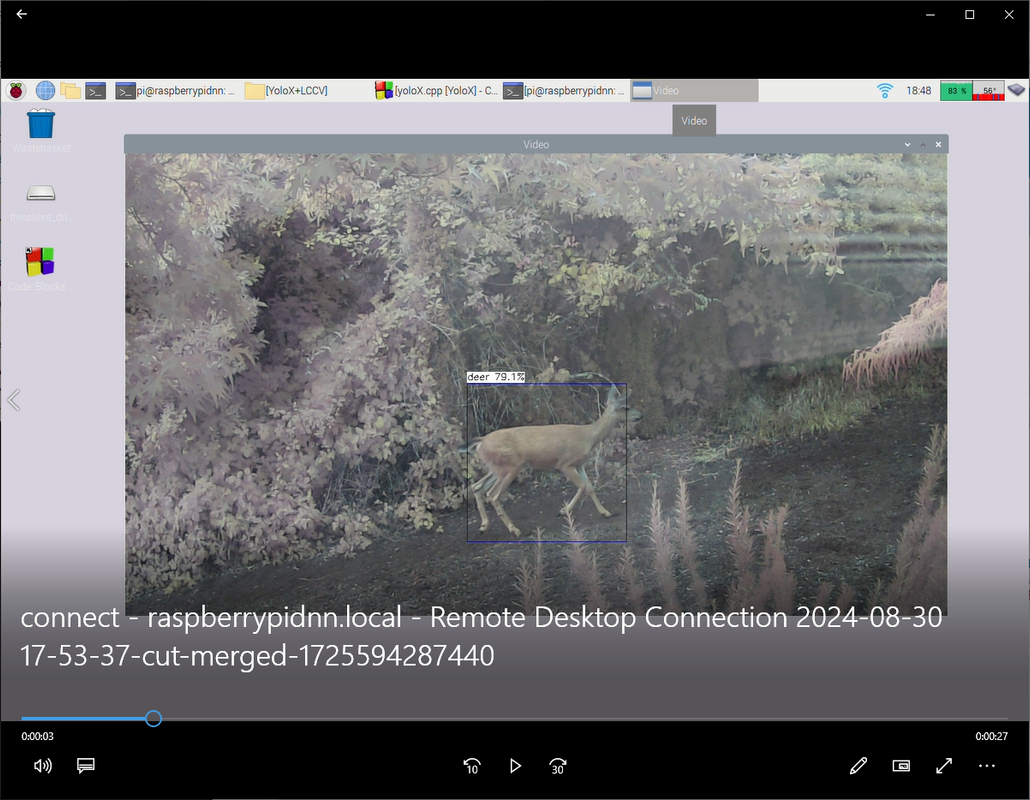

赞动手能力,杠杠地。。。fard 写了: 2024年 10月 30日 13:17 我这几年做的项目之一就是关于这个。难度是要在0.5秒检测出来,目前的问题是误报警太高,一大半都是误报警。根本的问题是美国现在没有做实事的人和环境了,都是像阿3那样忽悠。我是用一个Raspbbery Pi,用的YoloX模型,能把我家后院的鹿检查到,FPS是15,够快了,准确率还是不够,模型的训练和算法都有待进一步提高。所以我非常清楚,马斯克和他的FSD的印度主管基于纯图像的AI就是忽悠。把鹿识别错了无所谓,把人呢?AI是永远都不可能100%的,只能告诉你可能性是多高,比如这是我实时检测的一个截图,可能性是79.1%。阿3就是把可能性提高到了99.99%也是不行的,因为那0.01%的可能是一条活鲜鲜的人命,不是一头鹿。

我这个项目是针对一个特定的路段的,鹿在迁徙的季节在那里过马路,所以只针对鹿,不能让其它的动物导致误报警。

哈哈哈 有意思

问题是FSD字面是全自动驾驶,前面有个“fully”。branching 写了: 2024年 10月 30日 15:00 这个是很显然的,要是100%那就不是L2,所以我家model y回来最早的几件事之一就是加了一对鹿哨。自从10年前第一次撞鹿以后所有的车都加了,那是新年夜,及时刹住了,鹿在hood上坐了一小坑然后跑了。

again,这事我说过多少遍了,你不能单纯拿数字说话,而是要看里面的内容和分布。如果人开车1%事故率但里面99%的fender bender,fsd开车0.1%事故率但是里面50%涉及伤亡,你觉得谁更安全?macarthur 写了: 2024年 10月 30日 16:41 赞动手能力,杠杠地。。。

谁也没有办法做到100%,只能小数点后几个九。人眼识别也一样不靠谱,“视觉欺骗”么。这个其实是一个伦理(Ethic)上的难点 -- 人类司机一样不靠谱,可靠率比方说只能达到99.99%,开车上路一万次出一起车祸,你坐他开的出租没问题;FSD即便能达到99.9999%,你也仍然会担心:因为那0.0001%也可能是一条鲜活的人命。。。

不是 Foolly?

说的没错。fsd让人监管,实质上是在让人“预测”这系统会不会出错。leuning 写了: 2024年 10月 30日 18:05 各位,driverless 车已经商业化。

问题是: 那么一套系统,光硬件成本大概就在二十万美元以上。

几万美元车上的任何驾驶辅助系统,其实反而让驾驶更不safe: 它犯错的时候人为干预留下的时间极短。

fard 写了: 2024年 10月 30日 13:17 我这几年做的项目之一就是关于这个。难度是要在0.5秒检测出来,目前的问题是误报警太高,一大半都是误报警。根本的问题是美国现在没有做实事的人和环境了,都是像阿3那样忽悠。我是用一个Raspbbery Pi,用的YoloX模型,能把我家后院的鹿检查到,FPS是15,够快了,准确率还是不够,模型的训练和算法都有待进一步提高。所以我非常清楚,马斯克和他的FSD的印度主管基于纯图像的AI就是忽悠。把鹿识别错了无所谓,把人呢?AI是永远都不可能100%的,只能告诉你可能性是多高,比如这是我实时检测的一个截图,可能性是79.1%。阿3就是把可能性提高到了99.99%也是不行的,因为那0.01%的可能是一条活鲜鲜的人命,不是一头鹿。

FSD 0.31 crash per million mile, human driver 1.53 crash per million mile.leuning 写了: 2024年 10月 30日 18:05 各位,driverless 车已经商业化。

问题是: 那么一套系统,光硬件成本大概就在二十万美元以上。

几万美元车上的任何驾驶辅助系统,其实反而让驾驶更不safe: 它犯错的时候人为干预留下的时间极短。

这个我说过多少次了,这种比较毫无意义。human driver里面充斥了各种新手,teen driver,酒驾,road rage这类垃圾数据点拉低平均。如果过滤掉这些不正常数据点,用正常的human driver和fsd比,结果还不好说。另外单纯的事故率不能说明问题。如果human driver事故率1%但是99%的事故都是fender bender,而fsd 0.1%事故率但是50%有伤亡,哪个更安全呢?实际上有点common sense的人都明白电脑比人更容易避免fender bender。koko 写了: 2024年 10月 30日 19:18 FSD 0.31 crash per million mile, human driver 1.53 crash per million mile.

你是怎么得出来FSD更不safe的结论?

https://www.teslarati.com/tesla-fsd-safety-statistics/

不是近视眼,而是独眼龙。人是靠两只眼睛来判断距离的(多数食肉动物都是这样,两只眼睛长在前面,不知道的可以自己去查)。fsd其实也可以这么干,车前面一左一右两个摄像头,但那需要比现在多至少5~10倍的算力(因为要同时处理两个摄像头的图像并且计算距离)。单个摄像头就像人用一只眼睛看东西一样。

人出错是在意外的情况下,比如飞机要出事,必须是飞机自己发生了机械故障或者外部气流导致的异常,而AI 出错会在一切正常的情况下出现。所以不能用统计概率来比较。koko 写了: 2024年 10月 30日 19:18 FSD 0.31 crash per million mile, human driver 1.53 crash per million mile.

你是怎么得出来FSD更不safe的结论?

https://www.teslarati.com/tesla-fsd-safety-statistics/

我这个项目不是安装在车上,而是在公路的两旁,给过往的车辆报警。ccmath 写了: 2024年 10月 30日 18:29 赞专业视角。

问个技术问题,鹿经常是突然从路边跳出来的。事先可能不在摄像头的frame里面。15FPS够快吗?

我已经差点撞了好几次了,所以觉得这个问题必须解决。

实际上人出错里面有很大一部分都是因为一些和驾驶无关的事情比如心理问题导致的自杀、冲动情况下错误判断、情绪失控导致不理性,还有醉酒等等。这些事件并不能说明人开车不安全,因为这些人在这种条件下并不是在以正常状态驾驶车辆的。所以我一直说在统计人类驾驶员的时候应该把这些垃圾数据点去掉,只统计人在正常情况下开车的安全性和FSD做对比。fard 写了: 2024年 10月 30日 20:43 人出错是在意外的情况下,比如飞机要出事,必须是飞机自己发生了机械故障或者外部气流导致的异常,而AI 出错会在一切正常的情况下出现。所以不能用统计概率来比较。