#1 LLM的十大应用是什么?

发表于 : 2025年 7月 16日 09:59

1. 编程

2. 合成图片、录像

3. 编写文档

4. 教育

5. 科研

6. 语音识别、图像,视频识别

7.

8.

9.

10.

?

2. 合成图片、录像

3. 编写文档

4. 教育

5. 科研

6. 语音识别、图像,视频识别

7.

8.

9.

10.

?

自动驾驶是怎么联系上的?fantasist 写了: 2025年 7月 16日 11:49 LLM还可以生成语音,可以直接对话。

今年的热门主题是接入各种API后成为multi-turn agent,目前能力上限暂时取决于有多少交互接口,还没触及模型智能限制。

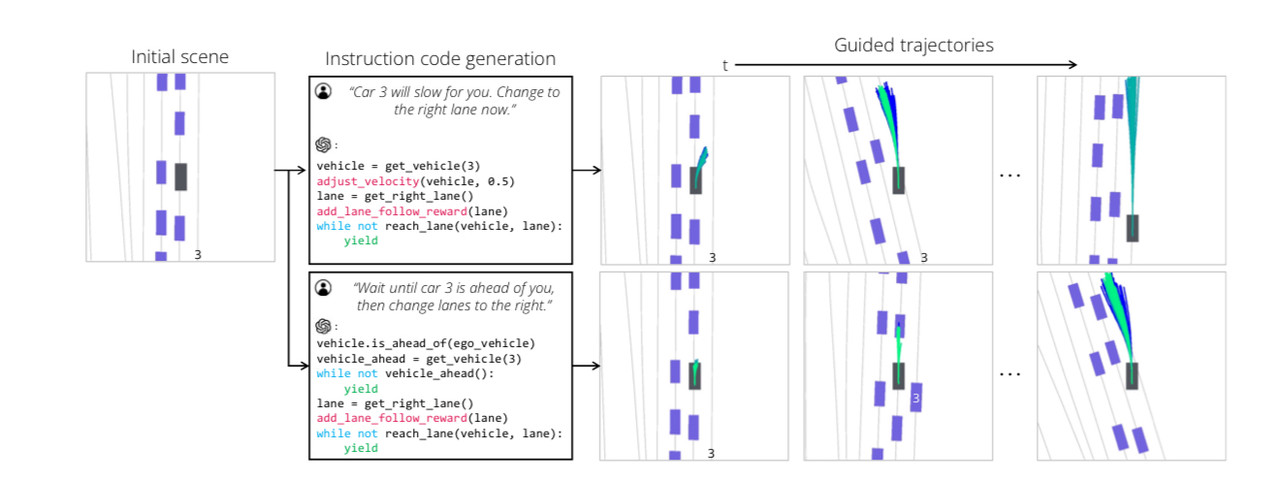

只谈transformer架构的话,它可以用于生成任何action sequence,目前在广告和自动驾驶已经成为标配。

vision transformer is transformer applied to pixels. It is not the same as LLM.fantasist 写了: 2025年 7月 16日 13:14 perception和planning/decision现在都用transformer的变种

有兴趣可以看看这篇survey https://arxiv.org/html/2403.07542v1

非要限定生成文字图片的LLM的话,那应该是没有wildthing 写了: 2025年 7月 16日 13:26 vision transformer is transformer applied to pixels. It is not the same as LLM.

你知道LLM用在自动驾驶的文章吗?

wildthing 写了: 2025年 7月 16日 13:26 vision transformer is transformer applied to pixels. It is not the same as LLM.

你知道LLM用在自动驾驶的文章吗?

真棒! 这是你自己的试验吗?图像也是chatgpt产生的吗?

syncophant is considered as a bug in llm model which can be corrected.

wildthing 写了: 2025年 7月 16日 09:59 1. 编程

2. 合成图片、录像

3. 编写文档

4. 教育

5. 科研

6. 语音识别、图像,视频识别

7.

8.

9.

10.

?

是的。所以效率低下

DLSSwildthing 写了: 2025年 7月 16日 09:59 1. 编程

2. 合成图片、录像

3. 编写文档

4. 教育

5. 科研

6. 语音识别、图像,视频识别

7.

8.

9.

10.

?

transformer从high level讲就是根据当前的context,predict next token。token本身只是一个数字,意义完全是训练时赋予的,可以是文字,可以是图像,可以是声音,可以是用户点广告的action,也可以是蛋白质折叠信息。根据输入数据种类的不同,内部结构比如attention需要一些变化,但本质是基本相同的。

No, it is widely used and needed particularly for those not systemicly trained.WideAnimals 写了: 2025年 7月 16日 17:01 syncophant is considered as a bug in llm model which can be corrected.

https://openai.com/index/sycophancy-in-gpt-4o/heteroclinic 写了: 2025年 7月 17日 16:24 No, it is widely used and needed particularly for those not systemicly trained.

Maybe this thing can also do "howifixthingsifkup" (one more to the list) in a brilliant/genius way.WideAnimals 写了: 2025年 7月 17日 17:19 https://openai.com/index/sycophancy-in-gpt-4o/

here is how openai addressed this issue: starting from 11:30